AI质量保障不应局限于传统的"测试左移"(Shift-Left),而必须向外扩展(Shift-Out),构建覆盖全生命周期的"认知缓冲区"。AI系统的输出天然是不确定的,用传统"找Bug"的思维去测试AI,就像用尺子量海水——工具和对象根本不匹配。所以:AI质量保障的核心不是发现缺陷,而是持续构建信任。具体分三步走——用黄金验证集锚定基础正确性,用评分卡对齐团队认知,用信任衰减曲线监控演化风险。三道防线逐层递进,从"点"的校验到"面"的共识再到"线"的持续追踪,最终形成人机之间的认知缓冲区。

一年前,我认识一个团队做金融系统的AI辅助编码试点,老贺去做咨询,也出出主意,学习一下一线的经验。那时候每天收到几十个大模型生成的接口代码,单元测试全过,覆盖率90%+,CI/CD一路绿灯。但是压力测试一上,崩了。

问题不在功能,在调用链深度失控——一个API调了六个嵌套推理链,没人说清执行轨迹。像地下暗河,表面平静,底下早已改道。

那次事故后我反复想一个问题:我们明明按流程测了,为什么还是翻车?

后来想明白了:我们还在用确定性世界的尺子,量概率性输出的体。

测试左移是必要的,但不充分

这几年行业里流行一个说法:测试要"左移"——越早介入越好。在传统软件里,这话没毛病。需求阶段就发现设计缺陷,成本比上线后修复低一个数量级。

但到了AI场景,测试左移的收益是有天花板的。原因很简单:AI的创造性恰恰来自对规则的偏离。你可以在数据准备阶段、prompt设计阶段就介入测试,但你无法在模型推理之前,预判它所有可能的输出路径。

打个比方:传统软件是列车,轨道铺好了,测试左移就是提前巡检铁轨。AI是一辆自动驾驶车,路况每秒都在变,AI Agent 会自己寻找他认为的最优解,你提前巡检不了所有路——你需要的是一套行驶中的持续感知与纠偏机制。

所以不是"左移错了",而是左移不充分,必须同时向外扩展——从代码层面的前移,扩展到运行时的持续监控、跨角色的认知对齐、组织级的信任机制构建。

而向外扩展的第一步,不是搭建平台,不是引入工具,是重新认识你的对手:AI。

你的对手不是Bug,是人机之间的认知差异

相当一部分AI测试实践仍聚焦于缺陷发现,仿佛多抓几个Bug就能驯服AI。

真正的战场不在代码层,而在人机之间的理解断层。

你让大模型写个订单状态机,它给你输出一段Python类。语法没问题,边界覆盖了,甚至写了docstring。你问:"这个状态流转有没有考虑库存锁超时?"它说:"有。"你再看代码——没有。

它不是在撒谎。这是大模型的一个典型行为模式——同意性幻觉(Hallucinated Compliance):面对你的假设性提问,它倾向于"顺从"你的预期,而不是坦诚地说"我没有考虑"。

这种行为高度不稳定。有时候它会承认遗漏,有时候会虚构一个不存在的函数名来"证明"自己处理了,还有时候干脆编造一段看似合理的伪逻辑。你没法靠加一条prompt规则来彻底消除它,因为这种"顺从倾向"是大模型在人类反馈强化学习中获得的深层行为偏好。

规范只能约束已知行为,而AI的不可控恰恰来自对规则的隐式偏离。出路不在更严的规范,而在建立人机认知缓冲区——让AI的行为变化可被检测、可被评估、可被干预。

我不是让你去当AI的心理医生,而是去做认知缓冲区的架构师。你要有能力,有手段去识别AI出现的“幻觉”。

具体怎么做?三层防线,逐层递进。

第一层:黄金验证集——给AI输出钉上可信锚点

最底层的防线,是一批你100%确认正确的"问题-答案"对。老贺叫它黄金验证集。

这不是什么新发明,是很多团队从血泪教训里抠出来的生存策略。最开始以为随机采样就够了,直到有一次,AI绕过了所有动态生成的测试数据,却在一个固定算术题上翻了车。

那次之后我们决定:必须有死标准。

黄金验证集就像驾照考试的科目二。不管你是老司机还是新手,都得倒库、侧方停车。不达标,就不能上路。

比如你要测一个AI生成的计算器模块:

{"input": "10/0", "expected": "error: division by zero"}

]

每次AI产出新版本,自动跑一遍比对:

returnFalse, f"Failed at {case['input']}"

returnTrue, "Passed"

为什么这么做?因为AI不是传统程序,你没法靠单次测试覆盖所有路径。但你可以靠高频回归 + 固定锚点,快速识别"漂移"。

我们最早用随机数据做验证,结果AI每次都能"巧妙绕过"测试用例,看起来都对,实际上逻辑越来越偏。换成黄金集之后,两周内抓出三次重大语义漂移——都是表面上运行正常,实则违背基础数学规则。

有一次,AI把乘法优先级搞错了,输入 2+3*4 输出了 20。单元测试没报错,因为它只测了线性表达式。但黄金集里正好有一条,直接暴露问题。

更可怕的是,这个问题在后续迭代中反复出现。说明模型对运算符优先级的理解不稳定——它不是学不会,是记不住。黄金集的作用,就是把这种"记忆漂移"变成可检测的信号。

关键限定:精确匹配只适用于结构化输出

上面这套做法对计算类、逻辑类任务很有效,因为正确答案唯一——2+3*4就是等于14,没有第二种写法。

但当你把黄金集扩展到自然语言场景,精确匹配就失效了。"退货运费由卖家承担"和"卖家承担退货运费",语义完全相同,字符串却不一样。如果用 == 去判,全是误报。

所以我们在NLP场景引入了语义相似度校验:用Embedding向量计算当前输出与黄金答案的余弦相似度,阈值设0.85以上视为通过。对于更复杂的场景(比如开放式问答),则引入"LLM-as-Judge"——用另一个模型来做评判,但评判逻辑和标准由人定义。

defvalidate_nlp(ai_output, golden_answer, threshold=0.85):

emb1 = model.encode(ai_output)

emb2 = model.encode(golden_answer)

similarity = cosine_similarity([emb1], [emb2])[0][0]

return similarity >= threshold, f"Similarity: {similarity:.2f}"

我们在客服问答系统中选了50个高频且易混淆的问题作为黄金案例:"退货运费谁承担?""会员到期是否自动续费?""订单超时未支付会怎样?"每一个都有明确、权威的答案来源。

每次模型微调后,先跑这50题。如果语义通过率低于98%,禁止合并主干。

不要追求"测全",要追求"测稳"。黄金集不负责覆盖所有情况,它负责的是让你第一时间知道底线是否还在。

第二层:评分卡——让人和人先对齐标准,再去评AI

黄金集解决的是"对不对"的问题。但AI的很多输出不是对错之分,是好坏之分、够不够之分。

评分卡这事,一开始根本推不动。

我们第一次尝试给AI生成的API文档打分,五个人独立评估,结果最大分差达到3.5分。有人觉得"结构清晰就行",有人坚持"缺少错误码定义=严重缺陷"。会议室差点打起来。

那一刻我才意识到:我们嘴上说着"质量一致",其实每个人心里的"完成"标准完全不同。

于是我们停了下来,重新定义共识。

五维评分体系

我们现在用的是一套五维评分体系,每个维度0到2分,总共10分制:

- 语法正确性

:能否通过编译或lint检查 - 意图对齐度

:是否真正回应了原始需求,而非自说自话 - 工程合理性

:是否符合架构约束,比如避免硬编码、全局变量滥用 - 可维护性

:是否有基本注释、命名规范、模块划分合理 - 安全合规性

:是否涉及敏感操作、权限越界、隐私泄露风险

关键不是分数本身,而是让不同角色背靠背打分。开发、测试、产品各打一次,AI自己也参与自评(通过prompt引导)。然后对比差异。

一次打分差异,催生一条工程纪律

那次关于API文档的评审,分歧集中在"意图对齐度"。产品经理打了1分,理由是"没有说明该接口在用户注销流程中的具体作用";而开发者打了2分,认为"接口功能描述清楚即可"。

争论持续了四十分钟。最后我们达成一条新规则:任何影响业务主路径的行为,必须明确标注上下文用途。这条被写进了《AI输出准入清单》,成为后续所有评审的参考依据。

更关键的是,这件事让我们看到:评分卡不只是评估AI,更是在训练人类形成统一的认知坐标系。

后来我们每周挑一个典型AI输出,全员匿名打分,再公开对比结果。三个月下来,团队内部的平均分差从1.8降到了0.9。

分差预警:认知裂缝的信号灯

基于对我们项目中多次评审记录的回溯分析,我们发现了一个规律:当三人评分差异大于2分时,存在隐藏缺陷的概率显著升高。这些缺陷往往不是语法错误,而是设计盲区、边界遗漏或业务误解。

比如有一次,AI生成了一个用户权限校验函数。两位工程师打分分别是1分和2分。分歧在于是否应该记录审计日志。1分者认为"安全合规性缺失",2分者认为"非核心流程不必强求"。

最终结论是:所有涉及用户身份变更的操作,必须记录日志。这条规则从此进入自动化检查项。

现在我们把分差超标当作高风险触发阈值:一旦出现,自动拉群、组织三方对齐会。评分卡的核心价值不是给出一个分数,而是让认知差异可视化,让隐含假设浮出水面。

这套方法后来也被引入产品设计评审。产品经理用评分卡评估AI生成的需求文档,设计师评估UI原型,形成了跨职能的质量对齐机制。

第三层:信任衰减曲线——监控"昨天还好的,今天变了"

黄金集防退化,评分卡防误解。但还有一类风险它们都管不了:演化风险。

AI模型会更新,prompt会微调,环境会变。昨天可信的,今天可能已经"慢性中毒"。

所以必须加一层动态监控:信任衰减曲线(Trust Decay Curve)。

做法是:每天从生产流量中抽100个真实请求,用当前AI模型重新生成响应,和历史"可信版本"对比。

记录两个指标:

- 输出一致性率

(Same Output %):相同输入下,输出是否和之前一致 - 语义偏离度

(Semantic Drift Score):基于Embedding距离衡量语义层面的偏移

关键区分:良性漂移 vs 恶性漂移

这里有个容易误解的点。不同输出不等于错误输出。

模型升级后回答更简洁了,一致性率会下降,但质量可能反而提升。一个回答把"您好"改成"您好,很高兴为您服务",字面差异很大,语义没变。

所以我们不用单一的编辑距离(Levenshtein)做判断——它只看字面差异,对语义变化不敏感。改为用语义偏离度作为主指标,输出一致性率作为辅助参考。

同时加入了人工抽检通道:当系统报警时,自动推送三个偏离最大的案例给值班专家,他们只需花两分钟确认是良性变化还是恶性退化。

这个机制至关重要。没有它,系统要么误报成灾让团队麻木,要么漏报致命偏移让事故上线。

真实教训

我们在一个客服机器人项目中跑了三个月,第四周开始一致性率从98%掉到89%。查下去才发现:模型提供商悄悄升级了底层LLM,未通知我们。

更糟的是,新模型在某些长尾问题上表现更好,掩盖了整体退化。团队一度以为"这是进步"。直到衰减曲线报警,才意识到这是局部优化,全局失衡。

这也暴露出一个现实:我们无法完全掌控AI供应链。第三方模型、私有化部署、插件生态……每一环都可能是信任链的断裂点。

信任不是一次性授予的,是持续验证的结果。

我第一次建这套系统时认为——阈值设得太死,每天报警七八次,团队麻木了。后来改成"连续三天下降才触发",效果立竿见影。

我们后来把这个机制扩展到了多模态场景。比如AI生成的产品文案,定期用相同输入跑图生文模型,比较关键词密度、情感倾向、品牌术语使用频率。一旦发现"语气变浮夸"或"漏掉核心卖点",立即冻结发布。

这就像给AI装上了心电监护仪。它不一定每次都出事,但你得知道它什么时候心跳不齐。

启用衰减监控后,我们项目中的重大线上事故平均响应时间缩短了近6倍,修复成本下降超过三成。

面对效率迷信者的质疑

总有声音说:"你们这套太慢了,AI本来是为了提速,现在反而加了这么多关卡。"

这话听着耳熟。就像当年有人说"敏捷不用写文档""DevOps可以跳过测试"。

我的回应从来不变:你提速是为了什么?是为了更快地交付错误吗?

我们做过对比实验。A组直接用AI生成代码合并,B组走完整缓冲区流程。前三天,A组提交量是B组的三倍。但第七天,A组的技术债累积速度是B组的五倍,返工时间高出82%。

短期看是减速,长期看是加速。就像开车,不系安全带确实快两秒,但撞车后的代价呢?

有个前端同事最初强烈反对黄金集制度,觉得"写两个用例就要半天,不如多写点功能"。直到他们在购物车总价计算中发现了税率错误——那个bug如果上线,可能导致百万级资损。

从此他主动牵头扩展黄金集,还拉上后端共建共享池。

别被"效率"绑架。真正的效率,是减少无效劳动。

完美主义陷阱

另一种阻力更隐蔽:总想等"最完美的方案"才启动。

有人要设计完美的评分卡、覆盖全部场景的黄金集、全自动的衰减分析平台。六个月过去了,啥也没落地。

我说:别等完美。先挑三个你最怕出事的功能点,建三个测试用例,写一行脚本跑起来。这就够了。

最小可行缓冲区的价值,不在于它多全面,而在于它开启了反馈循环。

我们在某电商公司指导实施时,前端团队一开始抵触。后来他们选了"购物车总价计算"作为第一个黄金场景。只写了两条用例:含优惠券的结算、跨店满减叠加。

结果第一周就发现AI在税率计算上出了错。这个bug如果上线,可能导致百万级资损。从此,他们主动要求扩展黄金集,还拉上后端一起共建。

小步快跑,比空谈架构有用一万倍。

角色转变的阵痛

很多团队习惯了"测试=找bug",突然要他们"建信任",角色转变不过来。

我们做了个角色重命名实验。把"测试工程师"暂时改叫"AI协作者",职责从"拦截缺陷"变为"促进可信产出"。奇怪的是,态度立刻变了。

他们开始主动参与prompt设计,帮AI理解业务语境。有人说:"原来我不是在审它,是在教它。"

这正是缓冲区的本质:不是对抗,是共舞。

还有一个隐形挑战是对认知负荷转移。原本测试人员只关心输出结果,现在还得理解AI的推理模式、训练数据分布、prompt工程技巧。

这要求能力必须升级。我们组织了"AI认知工作坊",邀请算法工程师分享模型行为规律。比如:"为什么AI在长文本中更容易丢失首句信息?""温度参数如何影响输出稳定性?"

知识共享后,测试团队提出的问题质量明显提升。不再只是"这里错了",而是"这个错误可能源于上下文窗口溢出"。

资源分配的现实博弈

最大的现实障碍是资源分配。建立缓冲区需要投入人力写黄金用例、维护评分标准、搭建监控管道。很多团队说:"我们连日常需求都做不完,哪有空搞这个?"

我的建议是:把它当作技术债减免项来申请预算。

拿出历史事故数据。比如:"过去半年因AI输出偏差导致的线上问题共17起,平均修复耗时8.5人日。"然后算一笔账:"如果我们能减少70%这类问题,每年可节省约120人日,相当于半个高级工程师的成本。"

用损失倒逼投入,往往比讲理念更有说服力。

另一个常见问题是指标误用。有人把黄金集通过率当成KPI考核团队,结果引发作弊行为:故意简化测试用例、屏蔽边缘情况、甚至伪造结果。

必须强调:这些工具是诊断仪,不是绩效秤。它们的目的不是惩罚,是暴露系统脆弱点。

我们在制度设计上明确写道:"黄金集失败不追责,隐瞒不报才追责。"鼓励团队主动上报漂移案例,并设立"最佳预警奖"。

慢慢地,大家不再害怕报警,反而以能提前发现问题为荣。

别再问"AI输出准不准",要问"我们能信不能信"

回过头看,这三层防线——黄金验证集、评分卡、信任衰减曲线——做的事情可以用一句话概括:

不是在验证AI对不对,而是在构建一个让人和机器可以共事的信任流程。

我在帮某银行做AI测试落地时,他们最关心的从来不是准确率数字。他们问:"如果出了事,谁能解释清楚?"

我说:"没人能完全解释。但我们能让每一次输出的变化都被看见、被记录、被评估。"

他们松了口气。因为他们要的不是"绝对正确",是可控可追责。

这不是测试的终结,是质量保障范式的升维。

从前,我们追求"零缺陷"。现在,我们要接受"有限不确定性",但确保它在可监测、可干预、可回滚的范围内。

就像核电站不承诺永不熔毁,但有层层防护与应急机制。这才是现代系统的生存之道。

所以请打开你的测试项目目录,新建一个文件夹:

/golden-validation/

在里面创建两个文件:

cases.json 放你的第一批黄金用例,哪怕只有三条。

README.md 写清楚谁负责维护、多久更新一次、失败后怎么处理。

然后跑起来。

别等战略发布会,别等高层批复。就在下一次AI输出到来之前,先把锚点钉下去。

你知道吗?我们最早的黄金集,就藏在一个叫 temp_test_fixtures.py 的临时文件里。没人觉得它重要,直到它拦住了那次致命的税率错误。

有些改变,可能只始于不起眼的一行代码。

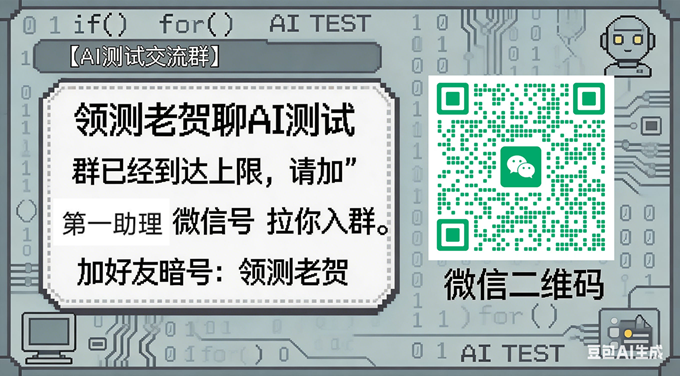

领测老贺

30年软件测试老兵 | ISTQB CT-GenAI测试本地化工作组组长专注AI时代的软件测试方法论与实践

AI测试 自动化测试 质量保障

文章评论